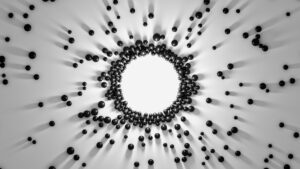

کارشناسان از افزایش استفاده از هوش مصنوعی در فنآوریهای نظامی، به ویژه سلاحهای خودمختار که میتوانند اهداف را بدون نظارت انسان انتخاب کرده و درگیر شوند، نگران هستند.

این میتواند مسئولیت پذیری را تضعیف کند و خطر هدف قرار دادن غیرنظامیان را در نقض قوانین بین المللی به خطر بیندازد.

در حالی که دستورالعمل پنتاگون در مورد هوش مصنوعی با هدف به حداقل رساندن سوگیری ناخواسته، امکان توسعه و استقرار تسلیحات مستقل در شرایط اضطراری را فراهم میکند ولی برای همه آژانسهای ایالات متحده اعمال نمیشود.

منتقدان میگویند که به اندازه کافی خطرات قانونی و اخلاقی را بررسی نمیکند.

پیمانکاران نظامی به طور فزایندهای سلاحهای خودمختار مانند پهپادها و سگهای روباتیک را توسعه میدهند و غزه به عنوان محل آزمایش برخی از سیستمهای ساخت ایالات متحده عمل میکند.

این میتواند درگیریها را گسترش داده و طولانیتر کند و در عین حال نیروها را از خطرات دور کند.

طرفداران معتقدند فناوریهای جدید دقت را افزایش میدهند، اما منتقدان خاطرنشان میکنند که حملات هواپیماهای بدون سرنشین همچنان باعث مرگ غیرنظامیان شده است. هدفگیری مستقل همچنین به دادهها و الگوریتمهایی متکی است که ممکن است دارای سوگیری باشند.

در نهایت، کارشناسان میگویند که تلاش برای فناوریهای جدید تسلیحاتی نباید از مسئولیت انسان در قبال تصمیمهای درگیری منحرف شود و جنگ ذاتاً از مرزهای اخلاقی، با یا بدون ماشینهای جدید فراتر میرود.

کار بیشتری در زمینه سیاست و نظارت بر هوش مصنوعی نظامی مستقل مورد نیاز است.

منبع: salon